近几年 AI 算力赛道彻底火了,但大家关注点一直都在单卡算力、集群规模、理论峰值上。这套逻辑在实验室阶段没问题,可当AI真正走进工厂、金融、医疗等实体产业,企业最关心的早已不是 “算力有多强”,而是能不能快速上线、稳不稳定、好不好用、成本高不高。

市场真正需要的,从来不是堆参数的“超级怪物”,而是买得到、交得快、用得稳、能赚钱的标准化算力产品。

就在这一行业关键转折点,中科曙光scaleX40重磅登场——全球首个无线缆箱式超节点,一亮相就成为产业落地的标志性产品。它不只是一台算力设备,更是一个强烈信号:AI 算力竞争,正式从“拼性能”转向“拼落地”。

今天我们从五大维度,全面解析这款革新性产品。

一、scaleX40为什么值得关注?

高端算力系统这些年发展很快,但部署端的老问题一直都在。

传统超节点方案普遍依赖光纤、铜缆模式,系统能力很强没错,但落到实际建设里,往往也伴随着部署周期长、现场联调复杂、故障点多、运维压力大等问题。尤其对企业客户来说,最头疼的从来不是有没有系统,而是系统能不能尽快落地、稳定运行、持续服务业务。

所以,scaleX40的出现,切中的并不是一个单点问题,而是一整套现实痛点。它想解决的,不只是性能怎么再往上走一步,而是高端算力怎么交付得更快、更稳、更省事。

二、scaleX40真正新在哪?

乍一看最吸睛的是无线缆,但它真正厉害的,是一整套落地导向的系统级创新。

首先是无线缆。

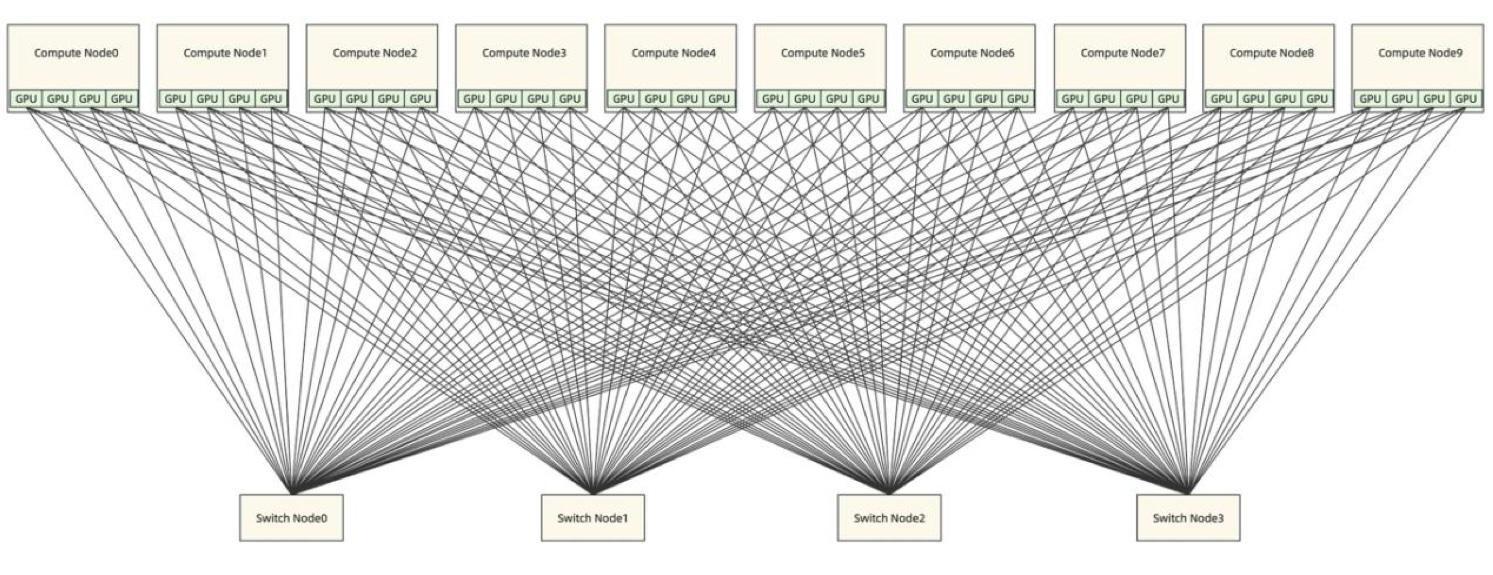

传统方案里,线缆不仅意味着连接,更意味着复杂的部署、调试和后期维护。线缆越多,链路越复杂,潜在故障点也越多。scaleX40采用正交无线缆一级互连架构,让计算节点与交换节点直接对插,本质上是在重新整理系统的连接关系。少掉的不是几根线,而是一整套复杂的部署和运维负担。

其次是箱式设计。

它采用标准19英寸箱式形态,实现算力单元与机柜解耦。这意味着,原本很多依赖现场完成的工作,被更多前移到了产品集成阶段。换句话说,客户拿到的不是一堆要重新拼起来的部件,而是一个边界更清晰、交付路径更明确的算力单元。

再看超节点能力。

从公开资料来看,scaleX40单节点集成40张GPU,总算力超过28PFLOPS(FP8),HBM总显存超过5TB,访存总带宽超过80TB/s,可支撑万亿参数大模型训练与推理。参数本身当然足够亮眼,但更关键的是,它不是在单纯堆性能,而是在把高密度算力做成一个更完整、更好交付的产品。

三、scaleX40解决了什么问题?

从产品逻辑上看,scaleX40的价值不只是“做强”,更是“做实”。

第一个是部署效率。

据了解,scaleX40可将部署周期从数月级大幅缩短到数小时。这个变化其实很关键,因为它不只是“快一点”,而是意味着很多原本属于工程实施阶段的复杂工作,被产品化吸收掉了。以前是项目推进要等系统慢慢建起来,现在更像是一个完整产品快速进场。

第二个是使用门槛。

高端算力过去往往更像少数大型机构才能高效使用的资源,采购门槛、建设门槛、运维门槛都不低。而scaleX40明确面向企业级AI场景,适配中小规模训练与推理需求,强调企业无需一次性大额投入,也能获得高端算力支撑。这其实是在把高端算力从“少数人能用”,往“更多企业能用”推进。

第三个是长期可用性。

很多系统前期搭得起来,后期却未必好维护。scaleX40在减少线缆复杂度的同时,也给出了99.99%的系统可靠性表述,并强调高密场景下的信号损耗和整体能耗同步优化。对企业来说,这种价值非常实际——买的不是一套参数,而是一套能长期稳定跑起来的能力。

四、为什么说它代表的是算力竞争的新变化?

中科曙光表示,scaleX40的意义不止于性能提升,更在于推动算力从“工程化建设”走向“产品化供给”。这句话其实是整件事的重点。

过去,高端算力更像是一个工程项目,拼的是集成能力、施工能力和长周期交付能力;而到了今天,企业更希望算力像产品一样被采购、部署和使用。谁能把复杂系统做得更标准化,谁就更有机会把高端算力真正推向更广泛的产业场景。

所以,scaleX40的价值,不只是发了一款新产品,而是代表一种新思路:

未来高端算力竞争,除了继续比性能,也会越来越看重交付效率、可用度、运维友好度,以及算力向业务价值的转化速度。

五、哪些场景更需要scaleX40?

从现有资料看,scaleX40已经给出了比较清晰的行业方向,比如制造、金融、医疗等。

在制造领域,它可以支撑工业缺陷检测、数字孪生仿真等应用。对制造企业来说,很多项目拼的就是部署速度和验证效率。

在金融领域,它可以适配风控模型训练、量化交易推理等场景,这类业务最看重的是持续稳定运行。

在医疗领域,它能支持医学影像分析、药物分子模拟,同时本地化部署还能降低数据跨域传输风险。

这些场景有一个共同点:它们需要的都不只是高性能,而是真正能落地、能持续跑、能尽快接业务的高端算力。

六、产业链

scaleX40所带动的是一整套高端算力基础设施链条。大致可以分为上游核心部件、中游整机与系统集成、下游应用与服务三部分。

上游核心部件主要包括GPU/加速卡、HBM、高速连接、PCB/载板、电源、散热与液冷、结构件等环节。

其中,和高密度超节点关系最紧密的,通常是高速互连、散热、电源、PCB、高端材料等细分方向。

中游环节主要是服务器整机、超节点系统、集成部署、调度平台与算力基础设施建设。

这一层决定了产品最终是以“设备”形态交付,还是以“解决方案”形态交付。

下游环节则对应模型训练、推理服务、行业应用、智算中心运营、算力租赁等方向。

随着AI应用深入产业,下游需求对上游和中游产品形态的牵引会越来越明显。